"Шпигл": Елита у области вештачке интелигенције упозорава на крај човечанства

Према стотинама стручњака, вештачка интелигенција (АИ) носи "ризик од изумирања" за човечанство. Најновије упозорење састоји се од једне једине реченице.

У упадљиво краткој изјави, стотине стручњака упозорило је на опасности које прете од вештачке интелигенције: "Смањењу ризика од уништења путем вештачке интелигенције треба дати глобални приоритет, у рангу са другим опасностима по друштво у целини, као што су пандемије и нуклеарни рат", пише у саопштењу.

Потписници овог апела су Сем Алтман, извршни директор компаније "Опен АИ", Демис Хасабис, шеф "Гугл дип мајнда", као и истраживачи вештачке интелигенције и добитници Турингове награде, Џефри Хинтон и Јошуа Бенгјо.

Тајванска министарка за дигиталне технологије Одри Танг, главни технолошки директор "Мајкрософта" Кевин Скот, музичарка Грајмс и бројни стручњаци за вештачку интелигенцију, из области истраживања и света бизниса, такође се налазе на листи.

Упозорење је издао Центар за безбедност вештачке интелигенције са седиштем у Сан Франциску. Поруку је први објавио "Њујорк тајмс". Према писању овог листа, изјава је намерно кратка како би је потписали стручњаци који би иначе имали различите погледе на конкретне опасности које представља вештачка интелигенција.

Кључно је да људи задрже контролу

Крајем марта, познате личности, попут Илона Маска и других стручњака за вештачку интелигенцију, објавили су отворено писмо у којем су позвали на шестомесечну паузу у истраживањима нових система вештачке интелигенције који превазилазе тренутни "Опен АИ" модел ГПТ.

"Моћни системи вештачке интелигенције треба да се развијају само када будемо уверени да ће њихов утицај бити позитиван и да ће се овим ризицима моћи управљати", наводи се у овом писму.

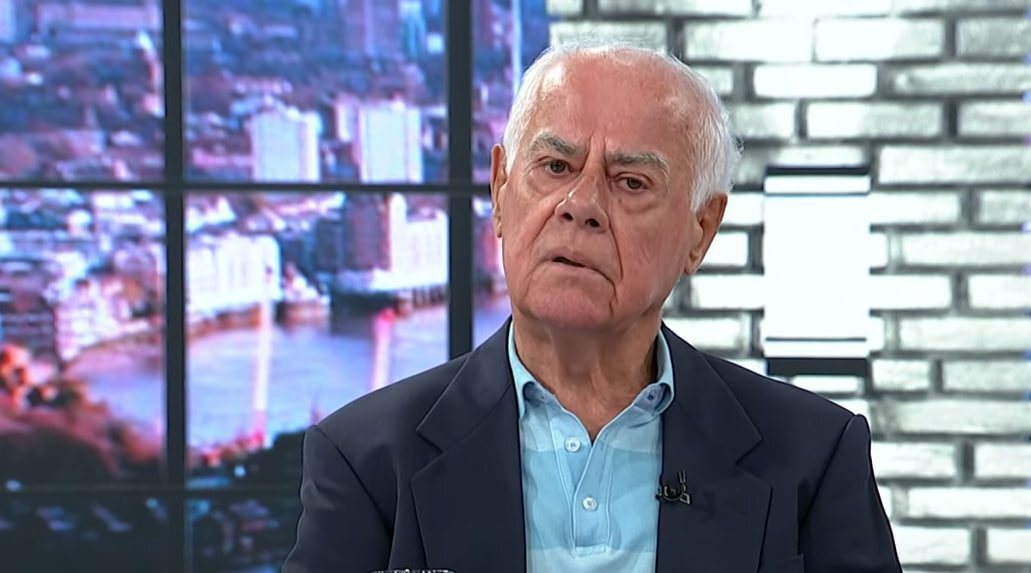

Почетком маја, пионир вештачке интелигенције Џефри Хинтон дао је слично упозорење, након што је напустио свог дугогодишњег послодавца, компанију "Гугл". Имена других стручњака, који су током протеклих неколико недеља или месеци у чланцима или интервјуима изразили своју забринутост због неконтролисаног коришћења вештачке интелигенције, укључена су у ову нову изјаву од уторка.

Упозорење, које је сада објавио Центар за безбедност вештачке интелигенције, посебно је упечатљиво јер су многи потписници запослени на високим позицијама управо у оним компанијама које тренутно раде на све моћнијим АИ моделима и апликацијама.

Сем Алтман је, на пример, у интервјуу за "Шпигл" прошле недеље рекао да је "веома забринут да би се биолошки ратни агенси могли развити уз помоћ АИ система".

Алтман не жели да повлачи црвене линије само у развоју: "Кључно је да одредимо границе за ову технологију у демократском процесу и да ми, људи, задржимо контролу. Узгред, и нама је као компанији потребна јасноћа. Управо зато треба да регулишемо ову област."

Међутим, постоје и неслагања у истраживачкој заједници.

Главни научник "Мете" за вештачку интелигенцију Јан Ле Кун, на пример, који је добио Тјурингову награду заједно са Хинтоном и Бенгјом, до сада није желео да потписује овакве апеле. Он оваква упозорења назива "АИ предвиђањима смака света".